2023年07月13日

当下,以AIGC技术为代表的新一轮人工智能蓬勃兴起,用人工智能大模型作画、写诗你也许已经不那么陌生,但这些只是人工智能大模型应用中的冰山一角。未来,金融、制造、交通等各行业都将可能实现更具针对性、落地垂直场景的行业大模型。

北京智源人工智能研究院(简称“智源研究院”)是国内最早开展大模型研究的科研机构之一,汇集了国际顶尖人工智能学者,聚焦核心技术与原始创新,一直致力于搭建高效、有活力的 AI 研发平台。

宏杉科技深度参与建设智源研究院超大规模人工智能模型训练平台,以120节点的宏杉科技万象全闪分布式存储,打造高性能数据存储系统,全闪容量达16PB,为智源大模型训练提供海纳数据、超高性能的存储服务。

为大规模数据提供超大容量、高扩展性支持

当前,用户在美团App应用中搜索【登记照】时,App会出现【婚纱照服务】推荐,这是智源AI大模型NLP自然语言处理能力的实际应用。通过对用户检索词进行“智能分析”,智源大模型可实现消费者需求的精准匹配,每天为7亿美团用户提供便捷服务。

大模型的“精准分析”能力从何而来?百亿规模参数的学习必不可缺。

宏杉科技万象分布式存储系统拥有强大的扩展能力,能够容纳大模型百亿规模参数以及训练中所产生的海量过程数据。用户可以根据需要,随时增加配置,通过扩展万象分布式存储节点或扩展分布式存储集群规模的方式,增加整体容量与性能,整体系统容量可扩展到数百PB,为大模型数据提供完美的“容身之所”。

为海量混合数据存储实现性能加持

在人工智能生成应用方面,智源研究院文图生成模型变身「写实主义画家」,画面生成真实如同摄影直拍;视频生成亦不在话下,一句话,为你展现经典电影画面,也可让世界名画动起来。

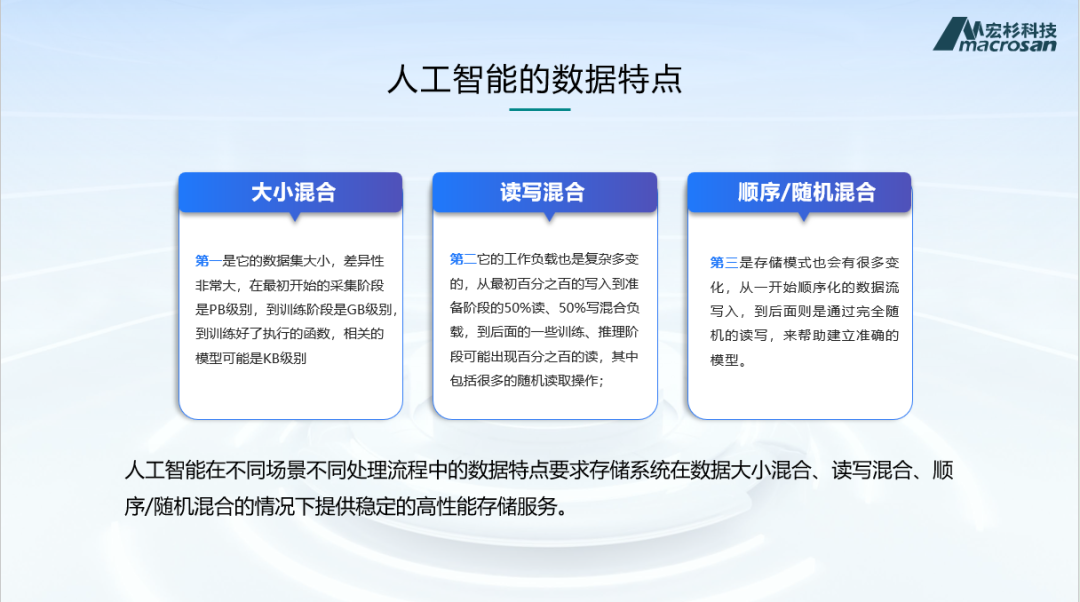

AI通过学习图文、交错图文、交错视频文本等海量多模态序列,实现在图像、文本和视频等不同模态间的理解、推理和生成。而这个工作过程中,数据的类型及大小处于一种“混合状态”,针对大、小文件随机存储产生延迟较高的问题,如何才能确保存储系统的高性能?

架构方面,宏杉科技选用万象全闪分布式存储为智源大模型打造高性能存储底座,全闪性能达到200W级别IOPS,带宽逾百GB/s,集群文件数量超百亿。万象分布式存储以领先的元数据集群技术,打造元数据集群存储系统架构,实现存储系统整体性能跃升——所有元数据服务器同时参与文件检索与定位工作,为智源大模型提供了近乎无限的文件存储数量和高效的文件检索服务,并且达到即插即用,性能与容量线性增长的效果。

针对智源大模型海量小文件读写场景,万象分布式存储不再进行低效的单个小文件的切片传输,而是以目录为单位进行小文件聚合传输,大幅提高网络传输和磁盘使用效率。在顺序读取大量小文件时,内存命中率超过96%,有效缩短了IO路径,降低了磁盘操作次数及数据访问延迟。

此外,万象分布式存储还支持RDMA技术,有效提升了大文件读写以及整体存储系统性能——数据能够绕过CPU,直接传到对端内存,避免多次的数据拷贝,同时减少了CPU占用,提升吞吐量,降低延时。

2022年,科技部发布了《关于支持建设新一代人工智能示范应用场景的通知》,越来越多的人工智能应用在中国落地开花。宏杉科技作为一站式数据存储专家,深度参与了北京智源人工智能研究院、青田联合创新赋能中心等AI项目建设。未来,宏杉科技将持续创新、发力AI行业,以更高性能、更低时延、更强扩展性的存储,助力人工智能产业研究,促进智能经济高效发展,与更多专家学者共同探索人工智能的星辰大海。